我们很高兴地宣布,GLM-4.7,Z.ai 最新的旗舰模型,现在可在SiliconFlow上使用,并提供第0天支持。与前代GLM-4.6相比,此次发布在编码、复杂推理和工具使用方面带来了显著进步——性能超越或甚至优于行业领导者如Claude Sonnet 4.5和GPT-5.1。

目前,SiliconFlow支持整个GLM模型系列,包括GLM-4.5、GLM-4.5-Air、GLM-4.5V、GLM-4.6、GLM-4.6V,以及现在的GLM-4.7。

SiliconFlow第0天支持包括:

竞争性定价:GLM-4.7 $0.6/M tokens (Input) 和 $2.2/M tokens (Output)

205K 上下文窗口:解决复杂编码任务、深度文档分析和扩展的代理工作流。

Anthropic & OpenAI兼容API:通过SiliconFlow部署,能够无缝集成到Claude Code、Kilo Code、Cline、Roo Code和其他主流代理工作流中,在复杂任务上有显著改善。

GLM-4.7的特别之处

GLM-4.7,您的新编码伙伴,具有以下功能:

核心编码卓越性

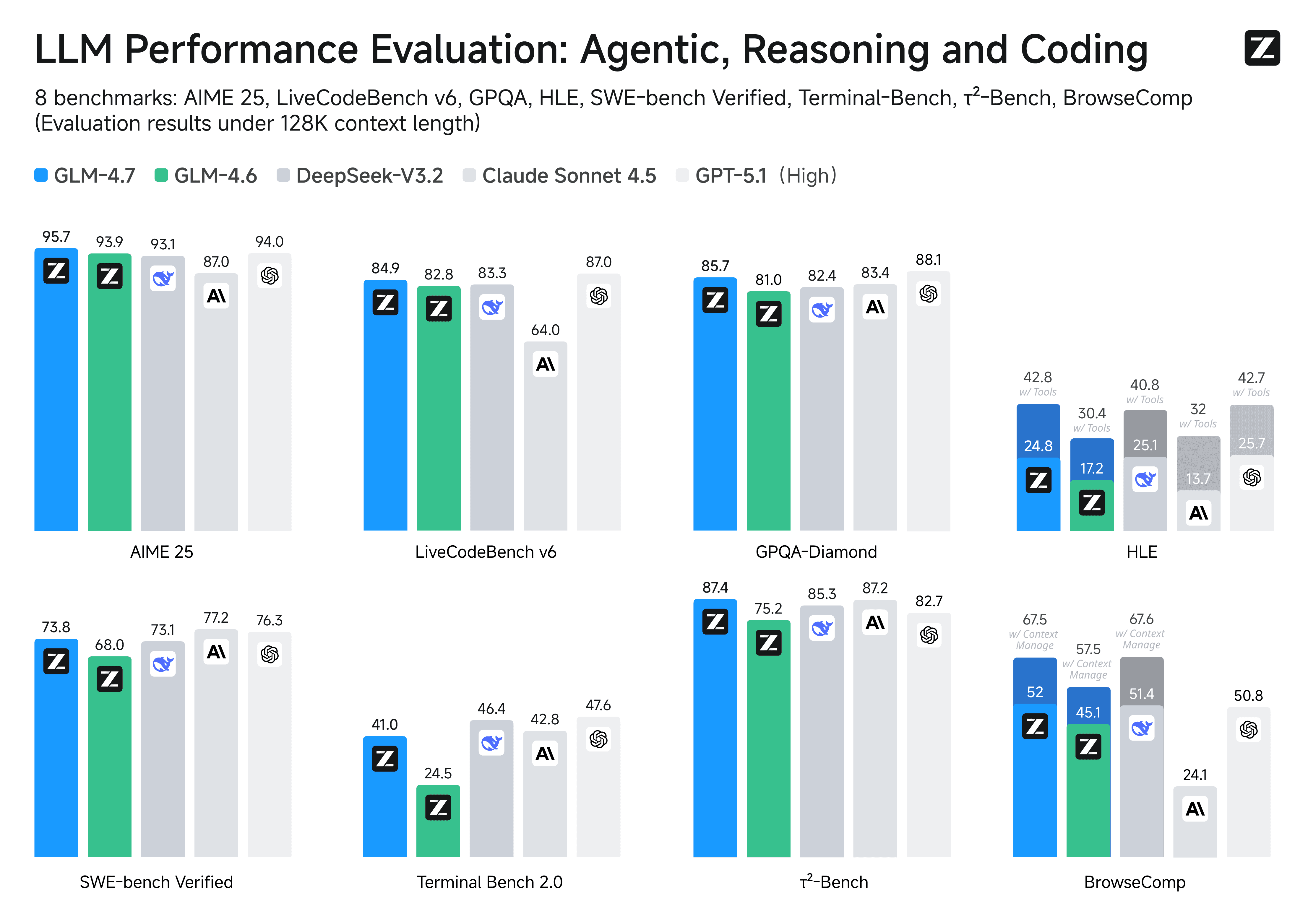

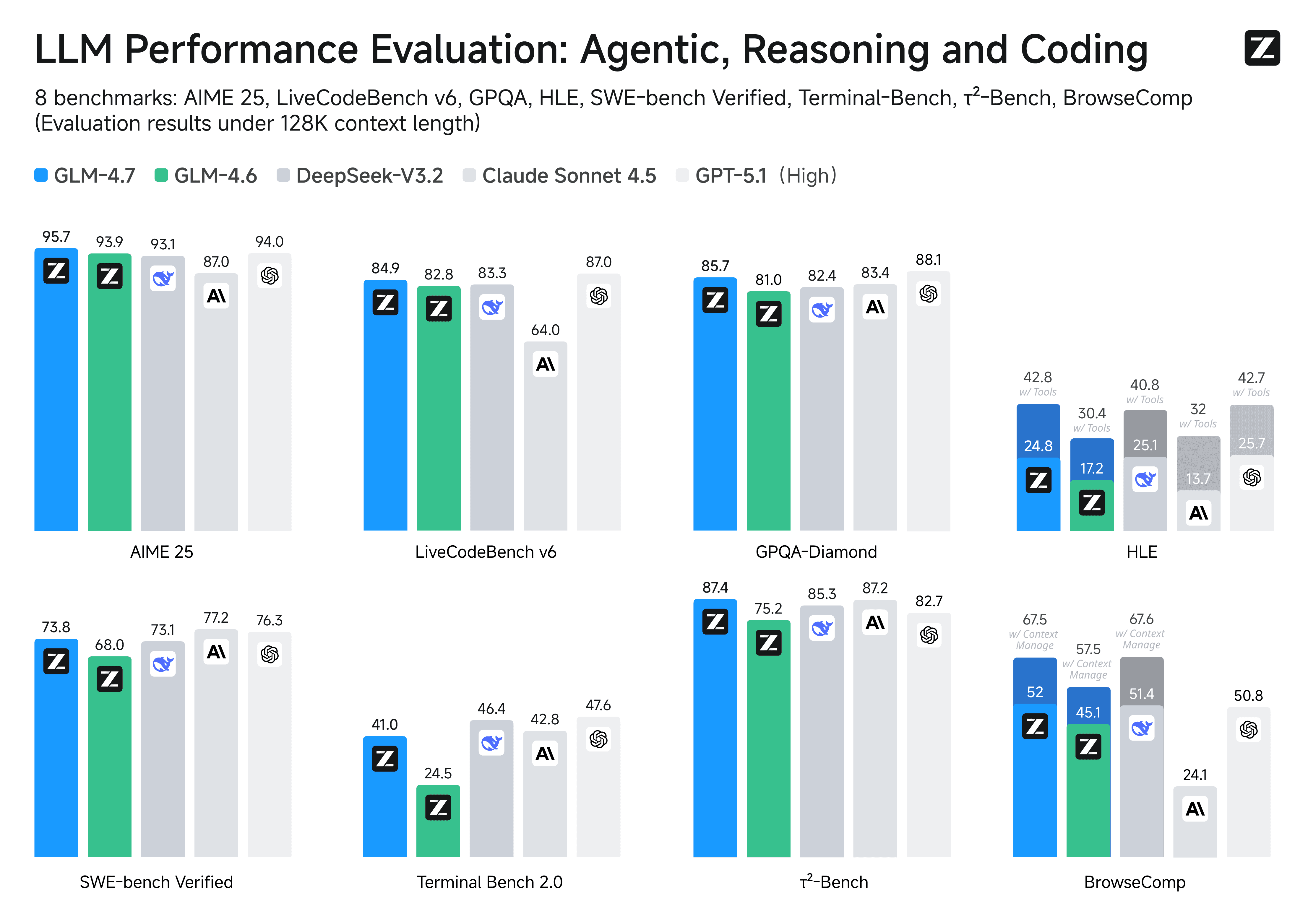

GLM-4.7为多语言代理编码和终端任务设定了新标准。与其前代相比,改进显著:

73.8% (+5.8%) 在SWE-bench验证中

66.7% (+12.9%) 在SWE-bench多语言中

41% (+16.5%) 在Terminal Bench 2.0中

该模型现在支持“思考后再行动”,在包括Claude Code、Kilo Code、Cline和Roo Code在内的主流代理框架上实现更可靠的表现。

Vibe编码

GLM-4.7在UI质量上取得重大飞跃。它生成更干净、更现代的网站,并生成布局和尺寸更准确的幻灯片。无论是原型设计界面还是创建演示文稿,视觉输出质量都明显提升。

高级工具使用

工具使用得到显著增强。在如τ²-Bench和通过BrowseComp的网页浏览任务等多步骤基准测试中,GLM-4.7超越了Claude Sonnet 4.5和GPT-5.1 High,展示了在复杂、现实世界工作流中出色的能力。

复杂推理能力

在数学和推理能力上有显著提升,GLM-4.7在HLE(人类最后考试)基准测试中达到42.8% (+12.4%),与GLM-4.6相比有显著改进。此外,您还可以在许多其他场景中看到显著进步,例如Chat、创意写作和角色扮演场景。

无论是在编码、创意还是复杂推理方面——立即开始体验GLM-4.7为您的工作流带来的变化。

立即开始

探索:在SiliconFlow模型广场尝试GLM-4.7。

集成:使用我们的OpenAI/Anthropic兼容API。在SiliconFlow API文档中查看完整API规范。

import requests

url = "https://api.siliconflow.com/v1/chat/completions"

payload = {

"model": "zai-org/GLM-4.7",

"messages": [

{

"role": "system",

"content": "You are an assistant"

},

{

"role": "user",

"content": "What's the weather like in America?"

}

],

"stream": True,

"max_tokens": 4096,

"enable_thinking": True,

"temperature": 1,

"top_p": 0.95

}

headers = {

"Authorization": "Bearer <token>",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

print(response.text)import requests

url = "https://api.siliconflow.com/v1/chat/completions"

payload = {

"model": "zai-org/GLM-4.7",

"messages": [

{

"role": "system",

"content": "You are an assistant"

},

{

"role": "user",

"content": "What's the weather like in America?"

}

],

"stream": True,

"max_tokens": 4096,

"enable_thinking": True,

"temperature": 1,

"top_p": 0.95

}

headers = {

"Authorization": "Bearer <token>",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

print(response.text)import requests

url = "https://api.siliconflow.com/v1/chat/completions"

payload = {

"model": "zai-org/GLM-4.7",

"messages": [

{

"role": "system",

"content": "You are an assistant"

},

{

"role": "user",

"content": "What's the weather like in America?"

}

],

"stream": True,

"max_tokens": 4096,

"enable_thinking": True,

"temperature": 1,

"top_p": 0.95

}

headers = {

"Authorization": "Bearer <token>",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

print(response.text)