目录

总结: GLM-5 现已在 SiliconFlow 上线。作为 Z.ai 最先进的开源模型,它专为复杂系统开发和长周期代理任务而设计。基于 744B 参数的 MoE 架构(每 token 有效 40B)构建,并在 28.5T tokens 上进行训练,GLM-5 在编码(SWE-bench Verified 上达到 77.8%)、代理执行(Terminal-Bench 2.0 上达到 56.2%)及长上下文推理与 DSA 集成方面提供前沿成果。可在 SiliconFlow 上以 $1.0/M Input | $3.2/M Output tokens 的价格和 205K 上下文窗口获取,GLM-5 为您提供一流的智能工程支持——准备好进行大规模生产部署。

Andrej Karpathy 最近的反思把握了我们的现状:“通过 LLM 代理进行编程正逐渐成为专业人士的默认工作流程。” 这种俏皮的“氛围编程”时代只是一个开始。开发人员现在真正需要的是能够可靠执行的 AI 系统,而不仅仅是偶然执行。

这正是 GLM-5 所提供的。作为 Z.ai 最先进的开源模型,它专为智能工程而设计,旨在应对复杂系统工程和长周期智能任务。拥有 744B 总参数(40B 有效),在 28.5T tokens 上训练,它带来了生产工作流程所需的一致性和可靠性。

现在,通过 SiliconFlow 的 GLM-5 API,您可以访问:

具有竞争力的定价:GLM-5 以 $1.0/M tokens (Input) | $3.2/M tokens (Output) 提供

205K 上下文窗口:集成 DeepSeek Sparse Attention,以节省部署成本而不牺牲长上下文能力。

顶级表现:在 SWE-bench Verified 上达到 77.8%,Terminal-Bench 2.0 上达到 56.2%,在 BrowseComp 上达到 75.9%。

无缝集成:通过 SiliconFlow 的 OpenAI 兼容 API 即时部署,与Claude Code、Kilo Code、Roo Code、OpenClaw 等无缝集成。

无论您是在构建代理、协调复杂的终端工作流程,还是开发需要深层次代码库理解的系统,SiliconFlow 的 GLM-5 API 都能提供您所需的智能。

GLM-5 的新特性

与 GLM-4.7 相比,GLM-5 在模型规模、后训练和长上下文效率方面进行了重大升级:

扩大参数和预训练

GLM-5 从355B 总参数(32B 有效)增加到744B 总参数(40B 有效),同时预训练语料库从23T扩展到28.5T tokens。这种更大规模的训练投入大幅提高了 GLM-5 的通用智能和知识覆盖率。

新异步强化学习:Slime

GLM-5 引入了 Slime,一种新型异步强化学习基础设施,显著提高训练吞吐量和效率,使得更细粒度的后训练迭代成为可能。

通过预训练和后训练的进步,GLM-5 比 GLM-4.7 在一系列学术基准上取得了显著提升,并在推理、编程和智能任务上达到了全球所有开源模型中的最佳表现,缩小了与前沿模型的差距。

DSA 集成

首次,GLM-5 集成了 DeepSeek Sparse Attention (DSA), 显著降低了部署成本,同时保留了长上下文能力。

顶级基准表现

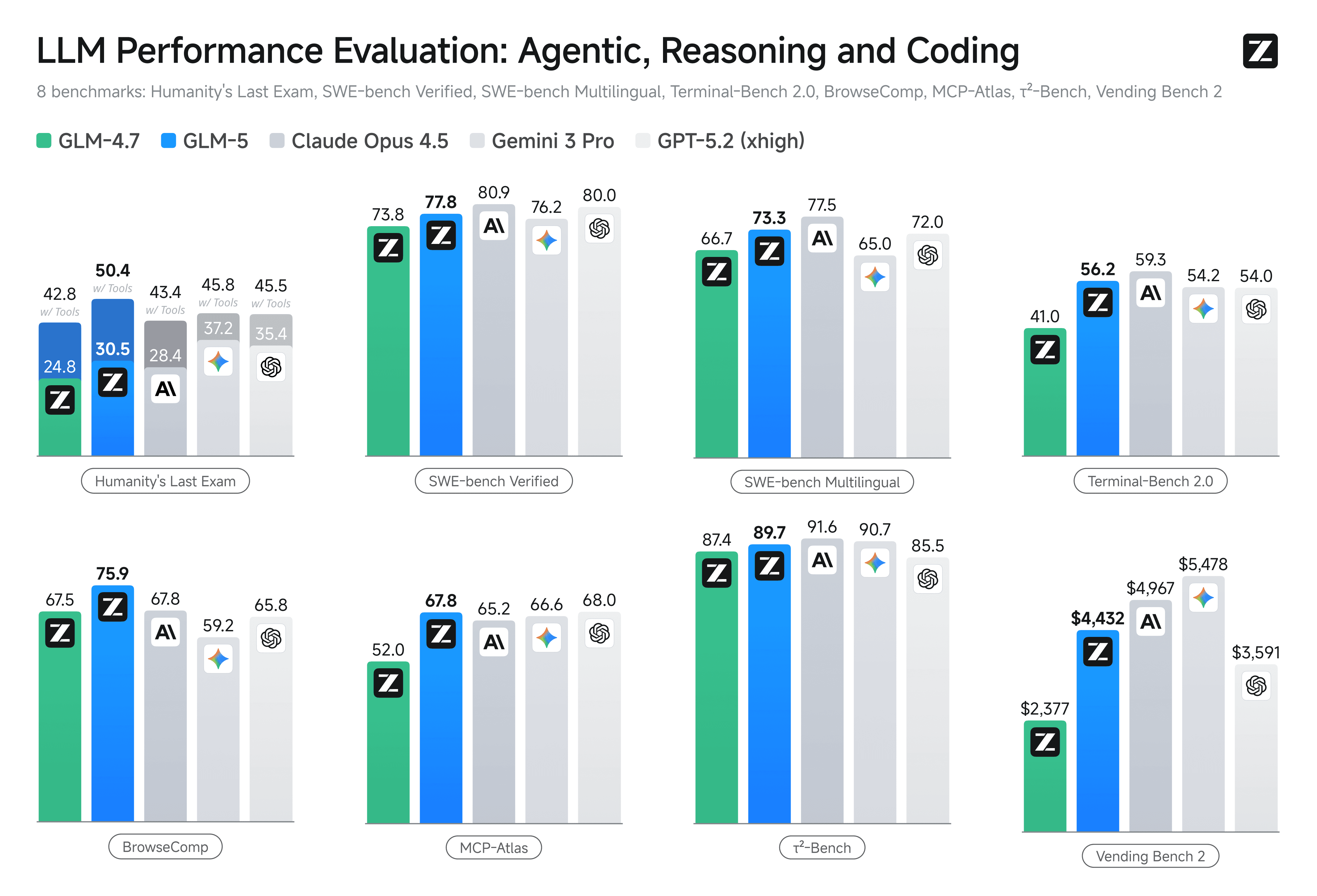

通过预训练和后训练的这些进步,GLM-5 实现了所有全球开源模型中的最佳表现,缩小了与前沿模型如 Claude Opus 4.5、Gemini 3 Pro 和 GPT-5.2 xhigh 的差距:

顶级智能表现:GLM-5 重新定义了开源智能基准。即使在与领先专有模型相比时,它在网络规模研究和综合 (BrowseComp) 中排名#1,同时在工具调用精度 (MCP-Atlas) 和多步场景规划 (τ²-Bench) 中设定了新标准。

前沿水平工程:模型的编程能力现在与 Claude Opus 4.5 对齐,并超过Gemini 3 Pro。通过在SWE-bench Verified (77.8%) 和Terminal-Bench 2.0 (56.2%) 上取得顶级开源成绩,GLM-5 展示了自动化代码库级调试和复杂系统工程所需的可靠性。

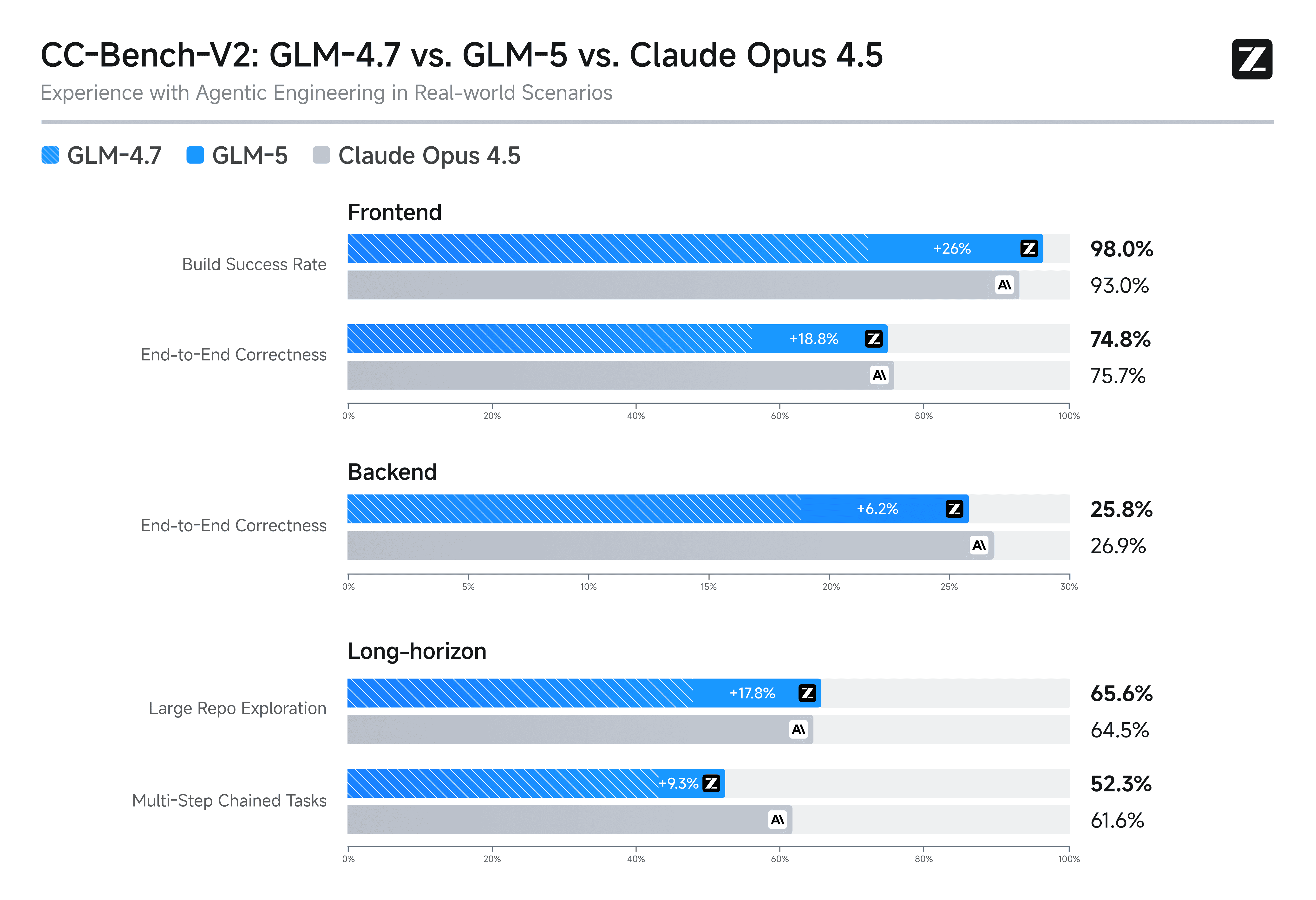

它在现实世界中的表现

在 Z.ai 的内部评估套件 CC-Bench-V2 中,GLM-5 在前端(98% 的构建成功率)、后端和长周期任务上比 GLM-4.7 有显著超越,缩小了与 Claude Opus 4.5 的差距。

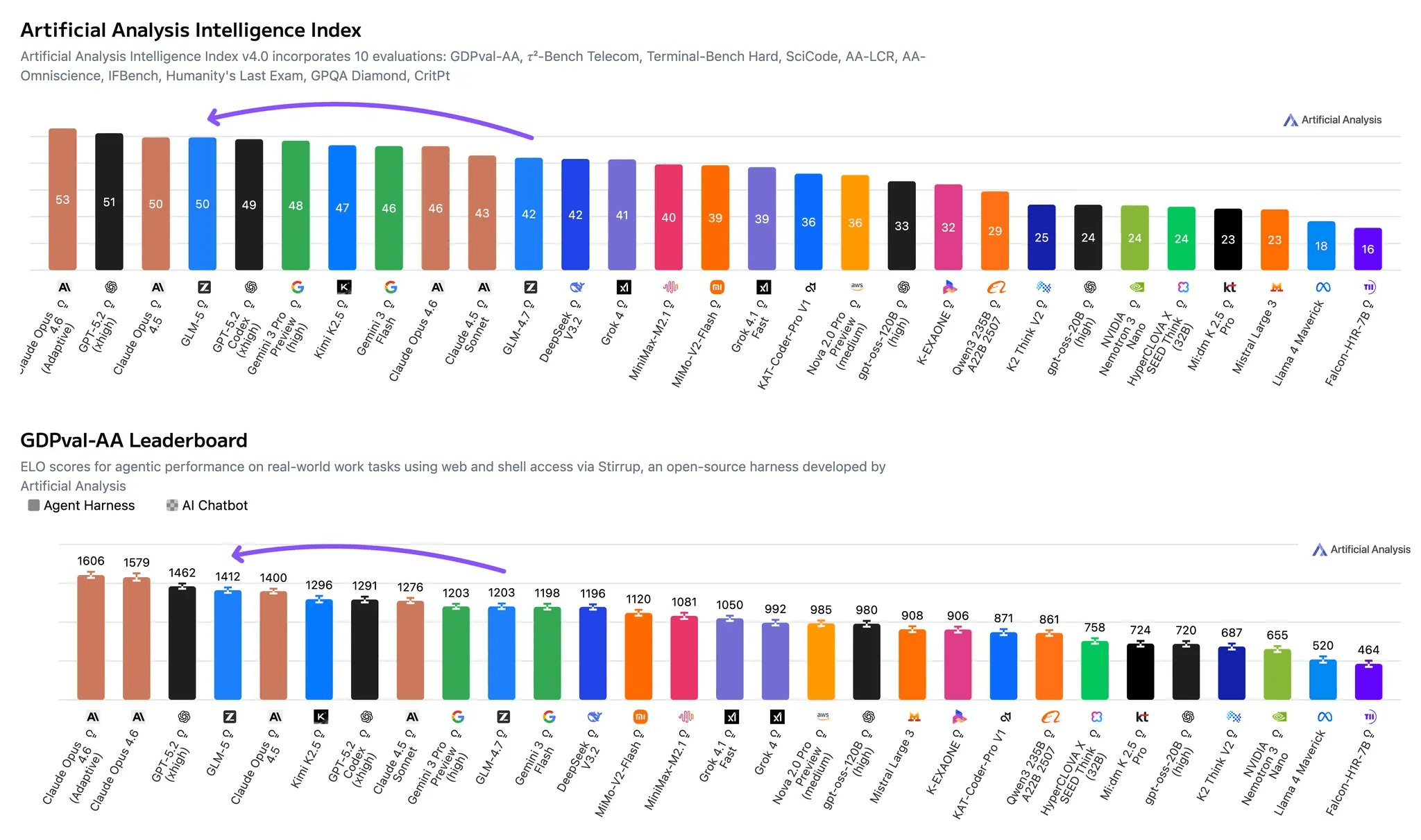

这一性能飞跃进一步得到了最新行业基准的验证来自人工分析:

智能指数: GLM-5 在 人工分析智能指数 v4.0 中得分50,成为首个达到此门槛的开源模型。

智能指数: 它在 智能指数中得分 63——在所有开源模型中排名最高,总体排名第三。

幻觉控制: 与 GLM-4.7 相比,该模型在 AA-全知指数方面也有显著改善,达到了人工分析目前测试的所有模型中最低的幻觉率。

立即开始

探索: 在GLM-5中尝试SiliconFlow 模型广场。

集成: 使用我们的 OpenAI 兼容 API。 在 SiliconFlow API 文档中探索完整的 API 规范。