目录

总结: 第3.5步闪光现在在SiliconFlow上实时运行。作为StepFun AI最强大的开源基础模型,它提供了前沿的深度推理、智能编码和长上下文处理,具备实时交互所需的效率。通过利用三向多Token预测达到100-300 tok/s速度和3:1滑动窗口注意力比率以高效处理262K上下文,它最大化吞吐量并尽量减少开销。现在在SiliconFlow上,以$0.1/M input | $0.3/M output 的价格提供,第3.5步闪光将精英水平的智能与即时响应带入您的生产工作流中。

我们很高兴将 第3.5步闪光 带入SiliconFlow。作为StepFun AI最强大的开源基础模型,它被设计为弥合推理深度与效率之间的差距。通过稀疏MoE架构仅激活其196B总参数中的11B,它在复杂数学和智能代理场景下与顶级专有模型(GPT5.2高/Claude Opus 4.5/Gemini 3 Pro)相比肩,同时保持实时交互所需的敏捷性。

现在,通过SiliconFlow的OpenAI兼容API,您可以访问:

极具竞争力的定价:第3.5步闪光以$0.1/M tokens(Input)和$0.3/M tokens(Output)

高速深度推理:快速生成速度达100-300 tok/s

高效的262K长上下文:在大型数据集上具有一致的性能,同时通过利用3:1 SWA比例显著减少计算开销

无缝集成:通过SiliconFlow即时部署或直接与行业标准工具如Claude Code、Cline、Kilo Code和Roo Code集成

无论您是在构建自主编码代理、进行深入研究还是处理海量代码库,SiliconFlow的第3.5步闪光API将为您提供所需的性能及即时响应能力。

在接下来的部分中,我们将深入分析第3.5步闪光背后的关键功能,展示其在现实世界中的表现,并提供配置技巧以最大化您的开发者体验。

第3.5步闪光的最新特性

对于许多开发人员来说,选择LLM长期以来都是在旗舰模型的“慢但深”推理和闪光模型的“快但浅”响应之间的折中。在今天的智能代理场景中,这种权衡尤其突出,复杂任务需要高水平的智能而不牺牲即时响应能力。

第3.5步闪光旨在弥合这一差距。下面,我们重点介绍能够在不中断推理质量的情况下实现快速执行的关键功能:

快速深度推理

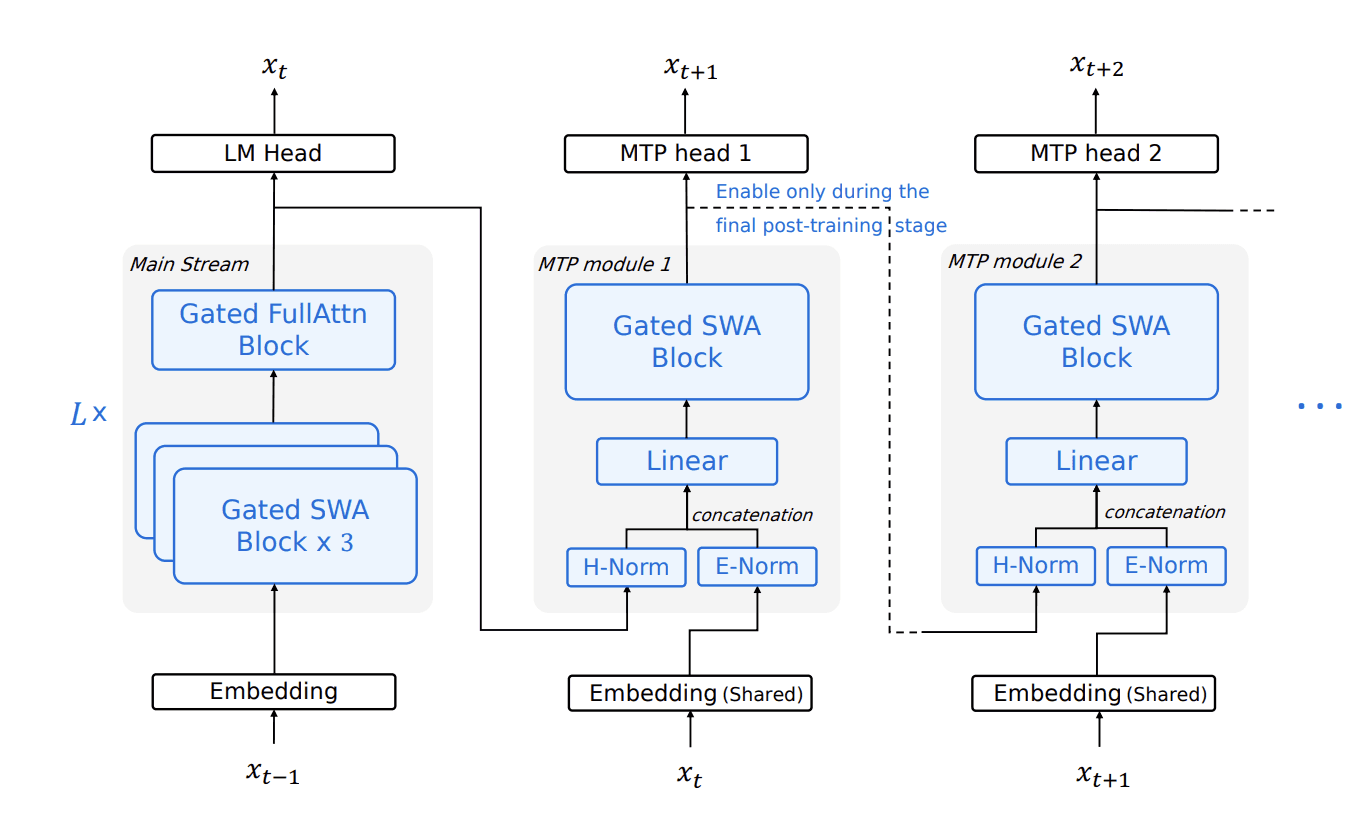

虽然传统聊天机器人是为阅读优化的,但代理则需要速度下的推理。借助三向多Token预测(MTP-3),第3.5步闪光在典型使用中实现了100-300 tok/s的生成吞吐量。根据官方数据,它在NVIDIA Hopper GPU上为单流编码任务达到350 tok/s的峰值,提供了复杂的多步推理链和即时响应能力。

高效的长上下文

第3.5步闪光支持262K上下文窗口,同时保持成本效率,使其适合如大规模数据集和长代码库等工作负载。它通过混合注意力设计,以3:1滑动窗口注意力(SWA)比例插入三层SWA层来替换每一层完整注意力层。这种方法在显著降低与标准长上下文模型通常相关的计算开销的同时,保持了稳定的长上下文性能。

SoTA编码和智能代理性能

为智能任务而构建,第3.5步闪光在长程基准测试中提供了强劲性能——74.4%在SWE-bench验证上,51.0%在Terminal-Bench 2.0上。这些结果反映出稳定的多步骤推理和工具使用能力,与支持持续改进的可扩展RL框架相结合。

基准测试 | 第3.5步闪光 | GLM-4.7 | DeepSeek V3.2 | Kimi K2.5 | Gemini 3.0 Pro | Claude Opus 4.5 | GPT-5.2 xHigh |

推理 | |||||||

AIME 2025 | 97.3 | 95.7 | 93.1 | 96.1 | 95.0 | 92.8 | 100.0 |

IMOAnswerBench | 85.4 | 82.0 | 78.3 | 81.8 | 83.3 | 84.8 | 86.3 |

HMMT 2025 | 96.2 | 95.3 | 91.4 | 93.3 | 96.0 | 92.3 | 98.3 |

编码 | |||||||

SWE-bench验证 | 74.4 | 73.8 | 73.1 | 76.8 | 76.2 | 80.9 | 80.0 |

Terminal-Bench 2.0 | 51.0 | 41.0 | 46.4 | 50.8 | 54.2 | 59.3 | 54.0 |

LiveCodeBench-V6 | 86.4 | 84.9 | 83.3 | 85.0 | 90.7 | 84.8 | 87.7 |

智能代理 | |||||||

τ²-Bench | 88.2 | 87.4 | 85.2 | 85.4 | 90.7 | 92.5 | 85.5 |

BrowseComp | 69.0 | 67.5 | 67.6 | 74.9 | 59.2 | 57.8 | 65.8 |

在现实世界中的表现

在这个实例中,Step-3.5-Flash被指定通过SiliconFlow的API分析欧洲供应链风险。它自主构建了5个Python模块,顺序地生成12个月的合成货运数据(可完全替换为您的真实业务数据集),集成实时天气API,并计算多因素风险评分。

该过程最终生成一个交互式仪表盘和一份综合HTML报告。具体来说,仪表盘自主集成了Leaflet.js用于地理空间可视化和Plotly.js用于交互式图表,创建了一个丰富、多维的分析体验,而无需在提示中明确指导。

提示:分析过去12个月的欧洲供应链数据并结合实时天气预报,评估下个月在欧洲的物流风险,然后为我生成一份数据报告。

这之所以成为可能,是因为第3.5步闪光在无瑕意图对齐的情况下卓越地协调工具,无缝从代码执行过渡到API协议,将内部推理与现实世界的影响连接起来。这个项目强力展示了其智能编码和复杂工具协调能力。

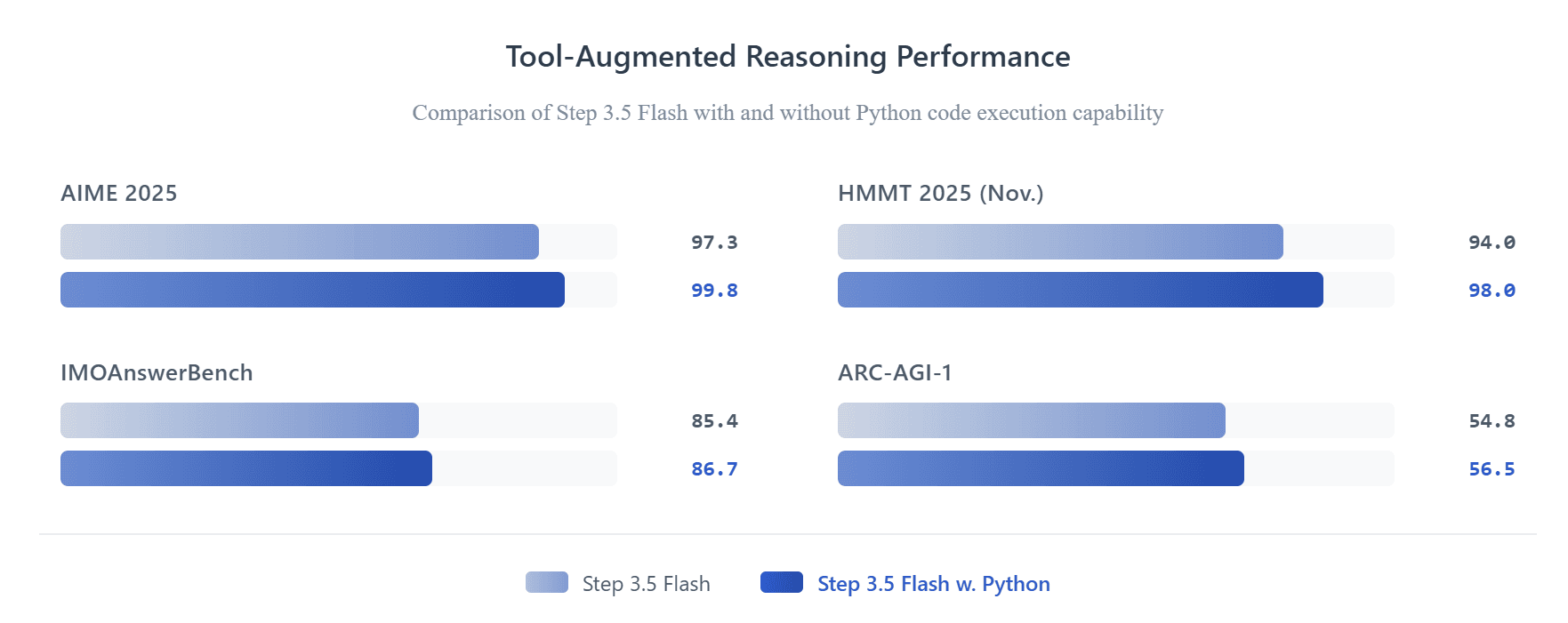

第3.5步闪光的优越工具使用能力进一步通过下面的性能指标得到证实。通过在其连锁思维推理中整合Python代码执行,该模型在精英逻辑和数学基准测试中,包括AIME 2025 (99.8)、HMMT 2025 Nov. (98.0)、IMOAnswerBench (86.7) 和 ARC-AGI-1 (56.5)中实现了显著的性能提升。

立即开始

探索:在SiliconFlow 模型广场中尝试 第3.5步闪光 。

集成:使用我们的OpenAI兼容API。在SiliconFlow API文档中探索完整的API规范。