Содержание

## Введение

*Примечание: Это произношение QwQ: /kwju:/, аналогично слову "quill".*

В быстро меняющемся ландшафте искусственного интеллекта, модели рассуждений становятся захватывающим рубежом технологических инноваций. Эти системы ИИ нацелены на симуляцию человеческих способностей к рассуждению, расширяя границы решения проблем и принятия решений. В авангарде этого захватывающего развития команда [Qwen](https://qwenlm.github.io/) от [Alibaba Cloud](https://www.alibabacloud.com/en/solutions/generative-ai/qwen?_p_lc=1) представила QwQ (Qwen с Вопросами) — открытый экспериментальный исследовательский Model, который обещает революционизировать возможности рассуждения ИИ и аналитические способности.

## Спецификации Model

QwQ-32B-Preview — это сложный AI Model с впечатляющими техническими характеристиками, которые выделяют его в текущей экосистеме AI. Построенный на архитектуре трансформера, Model включает в себя передовые технологии, включая RoPE (Rotary Position Embedding), активацию SwiGLU, RMS Normalization и Attention QKV bias. С значительными 32.5 миллиардами параметров (31.0 миллиарда без Embedding), Model затем состоит из 64 слоёв и использует сложный механизм внимания с 40 головами для Q и 8 головами для KV.

Одной из самых замечательных особенностей QwQ является его обширная длина контекста, поддерживающая полный 32,768 tokens. Это значительное окно контекста позволяет Model поддерживать согласованность и глубину в сложных задачах рассуждений, что позволяет получать более нюансированные и комплексные ответы по сравнению со многими существующими моделями.

## Впечатляющие показатели производительности

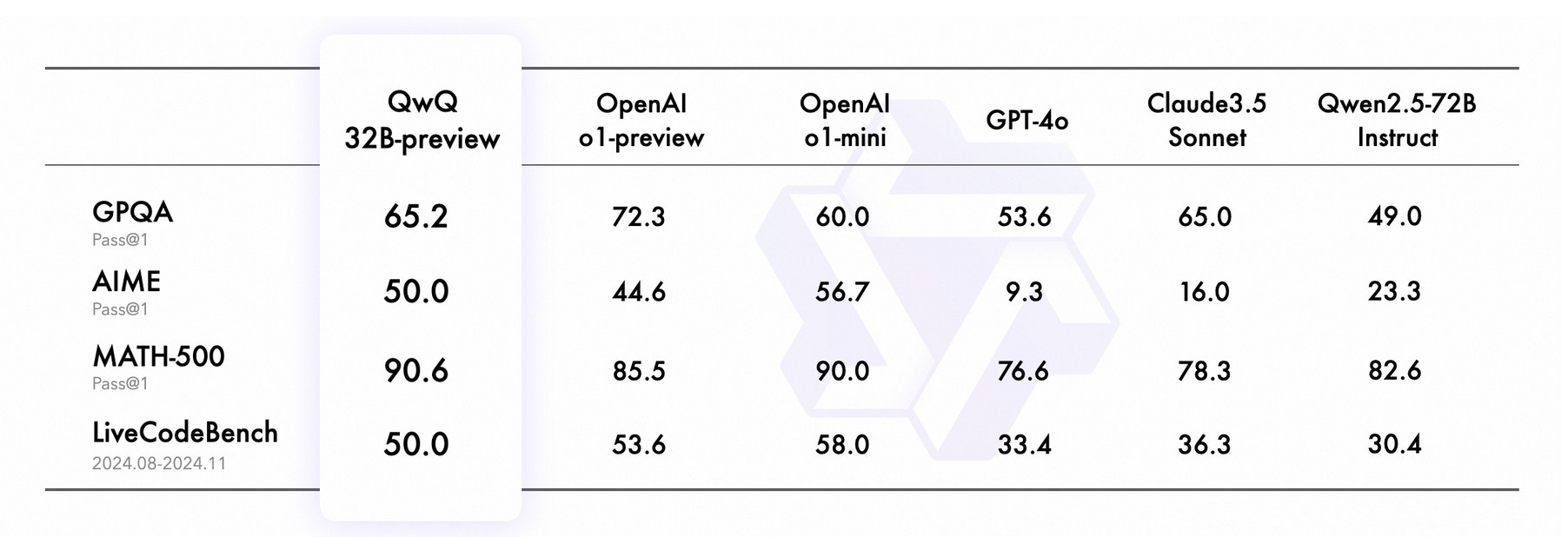

Model QwQ показала исключительную производительность на различных эталонах, позиционируя себя как конкурентоспособный AI для рассуждений с возможностями, самоценными как предложения OpenAI. Его показатели производительности особенно примечательны:

Производительность QwQ 32B-preview на различных эталонах подчеркивает его универсальность и силу в различных областях. На эталоне для вопросов на уровне аспирантуры (GPQA) QwQ достиг впечатляющего показателя в 65.2%. Хотя этот результат конкурентен с Claude3.5 Sonnet (65.0%), он уступает лидирующей производительности OpenAI o1-preview на уровне 72.3%. Тем не менее, достижение QwQ подчеркивает его передовые возможности в научном рассуждении, делая его надёжным инструментом для решения сложных вопросов в этой области.

В математическом решении задач QwQ действительно оценен на 50.0% на эталоне AIME, демонстрируя его сбалансированный подход к математически-фокусированным рассуждениям. Однако его производительность на MATH-500 была исключительно высокой, достигнув поразительных 90.6%. Этот показатель помещает QwQ впереди других моделей, таких как GPT-4o, демонстрируя его мастерство в решении сложных математических проблем по различным темам.

QwQ также обеспечивает надёжные результаты в задачах программирования, набрав 50.0% на эталоне LiveCodeBench. Этот показатель отражает его способность эффективно справляться с реальными кодировочными сценариями. Его последовательная способность интерпретировать и решать проблемы кодирования подчеркивает его потенциальные возможности как универсального помощника по программированию.

В целом, производительность QwQ показывает хорошо сбалансированный Model с выдающимися возможностями в области математики и научного рассуждения. Его способность отвечать на сложные запросы, такие как сложный "Strawberry Question", демонстрирует его Precision и адаптируемость. Хотя есть место для улучшения в некоторых областях, таких как GPQA и AIME, QwQ остаётся сильным претендентом в конкурентной среде AI Models, предлагая широкий спектр приложений и практических применений.

## Передовые возможности рассуждений

Что действительно отличает QwQ, так это его сложная методология рассуждений. Model не просто предоставляет ответы, но и участвует в сложном процессе рассуждений. Он демонстрирует способность выполнять многомерные рассуждения, строя сложные мыслительные процессы, которые включают глубокую интроспекцию. Это включает:

* Оспаривание собственных предположений

* Участие в внимательном внутреннем диалоге

* Анализ каждого шага своего процесса рассуждений

Этот мета-когнитивный подход позволяет Model QwQ генерировать более нюансированные и рефлексивные ответы, имитируя человеческие рассуждения более тесно, чем традиционные языковые модели.

## Инсайт от сообщества

Недавний видеоролик на YouTube с названием "Да, QwQ отличный: Chaining Prompt с моделью рассуждений Qwen и QwQ (Ollama + LLM)" предоставляет захватывающие инсайты о возможностях QwQ и его потенциальных приложениях в реальном мире. В видео рассматриваются как сильные стороны, так и ограничения QwQ Model, предлагая практическую перспективу по его реализации.

### 1. Chaining Prompt: Прорывная техника

Одним из самых захватывающих разработок, обсуждаемых в видео, является концепция Chaining Prompt. Эта инновационная техника включает в себя использование Output одного prompt как Input для другого, эффективно создавая более сложный и нюансированный AI-взаимодействие. Автор видео продемонстрировал этот метод, используя Ollama Qwen 2.5 coder Model, демонстрируя, как последовательное направление может значительно улучшить производительность AI.

### 2. Практические приложения

Видео также подчеркивает несколько практических приложений Chaining Prompt, с особым акцентом на генерацию контента. Например, спикер проиллюстрировал двухэтапный процесс для генерации SEO-оптимизированных заголовков. Этот подход не только улучшает качество Output, но и демонстрирует способность Model участвовать в сложных, многомерных задачах рассуждений:

* Первый prompt может служить двигателем рассуждений, генерируя потенциальные заголовки

* Второй prompt будет извлекать и уточнять эти заголовки с использованием более лёгкого Model

Видео завершается оптимистичным взглядом на локальные AI Models, предполагая, что решения, такие как QwQ, представляют перспективный путь в развитии AI. Спикер намекает на будущее содержание, включая прогнозы на 2025 год, и призывает к вовлечению общественности и продолжению исследований методов Chaining Prompt.

## Ограничения и соображения

Несмотря на свои впечатляющие возможности, QwQ является экспериментальной предварительной версией с несколькими важными ограничениями, которые пользователи и исследователи должны учитывать:

**Смешение языков** остается вызовом, поскольку Model иногда непредсказуемо переключается между языками, что может указывать на неясность ответа. Также присутствует тенденция к входу в **Рекурсивные циклы рассуждений**, потенциально генерируя длинные ответы без достижения окончательного результата.

**Меры безопасности и этические соображения** являются значимыми в различных областях, особенно в мире AI. Модели необходимы улучшенные меры безопасности для обеспечения надёжной и безопасной работы. Пользователям рекомендуется соблюдать осторожность при реализации и тщательно оценивать её Output. Тем не менее, хотя QwQ превосходит в математических и кодировочных областях, остаётся некоторый **потенциал для улучшения в эталонах**, таких как рассуждения на основе здравого смысла и тонкое понимание языка.

## Доступ к QwQ

Исследователи и разработчики, заинтересованные в изучении этого революционного Model, могут получить к нему доступ через несколько платформ:

* **GitHub:** [https://github.com/QwenLM/Qwen2.5](https://github.com/QwenLM/Qwen2.5)

* **HuggingFace Model:** [https://huggingface.co/Qwen/QwQ-32B-Preview](https://huggingface.co/Qwen/QwQ-32B-Preview)

* **ModelScope Model:** [https://modelscope.cn/models/Qwen/QwQ-32B-Preview](https://modelscope.cn/models/Qwen/QwQ-32B-Preview)

* **HuggingFace Demo:** [https://huggingface.co/spaces/Qwen/QwQ-32B-preview](https://huggingface.co/spaces/Qwen/QwQ-32B-preview)

## Заключение

Рефлексивное заключение команды Qwen отражает дух этого инновационного начинания: "Мы не знаем точно, куда ведет этот путь, но продолжаем двигаться вперед с непоколебимой решимостью — к истине, к интеллекту, к области, где происходят удивительные достижения." По мере того как AI продолжает развиваться, такие модели, как QwQ-32B-preview, представляют значительные шаги к более интеллектуальным, рефлексивным и нюансированным системам искусственного рассуждения. Хотя они не идеальны, они дают представление о будущем, где AI может участвовать в более человечных когнитивных процессах.

Наконец, оставайтесь на связи для получения обновлений на этом захватывающем технологическом рубеже!