Menguasai Kreativitas dengan Precision: Bagaimana ControlNet Mengubah AI Text-to-Image

Daftar Isi

## Pendahuluan

Dunia pencitraan yang dihasilkan oleh AI berkembang pesat, dengan model dan teknik baru yang mendorong batas kreativitas dan Precision. Di antara inovasi-inovasi ini, ControlNet muncul sebagai alat terobosan, memungkinkan kontrol yang lebih besar atas proses kreatif dalam pembuatan gambar dari teks. Teknik jaringan saraf yang inovatif ini telah menawarkan kontrol dan Precision yang belum pernah terjadi sebelumnya dalam menciptakan konten visual, terus menjembatani kesenjangan antara deskripsi tekstual dan gambar yang sangat disesuaikan.

## Apa itu ControlNet?

ControlNet adalah Model jaringan saraf yang dirancang untuk menyempurnakan dan membimbing proses kreatif sistem AI teks-ke-gambar, seperti Stable Diffusion. Ini mewakili kemajuan signifikan dalam AI generatif, memberikan pengguna kontrol yang sangat rinci atas proses pembuatan Gambar. Berbeda dengan model teks-ke-gambar tradisional yang menghasilkan gambar berdasarkan masukan teks semata, ControlNet kini memungkinkan manipulasi yang canggih dari elemen visual melalui kondisi Input tambahan.

## Arsitektur Teknis dan Fungsionalitas

Inovasi inti dari ControlNet terletak pada kemampuannya untuk mempertahankan kekuatan kreatif dari model difusi sambil memperkenalkan kontrol spasial yang Presisi. Dengan menggabungkan Input kondisi tambahan, seperti peta tepi, peta kedalaman, masker segmentasi, atau estimasi postur, teknologi ini memungkinkan pengguna untuk membimbing proses generasi gambar dengan ketelitian yang mengagumkan.

Pada intinya, ControlNet menggunakan arsitektur jaringan saraf yang unik yang bekerja bersama model difusi yang ada seperti Stable Diffusion. Sistem ini beroperasi dengan:

* 1. Menerima berbagai jenis Input kondisi di samping masukan teks

* 2. Mempertahankan kemampuan generasi model asli

* 3. Memperkenalkan mekanisme kontrol rinci tanpa latihan ulang yang ekstensif

Bagi mereka yang mencari pemahaman praktis tentang penerapan ControlNet, tutorial Video "Tutorial ControlNet Stable Diffusion Dalam 8 Menit" menyediakan panduan komprehensif tentang penggunaan ControlNet, sebuah ekstensi yang meningkatkan kontrol pembuatan gambar dengan menerapkan berbagai referensi gambar untuk membuat peta kontrol seperti pose dan kedalaman. Dirancang bagi mereka yang tertarik menjelajahi ControlNet dalam kerangka kerja Stable Diffusion, tutorial singkat ini memberikan gambaran umum yang komprehensif tentang prosedur instalasi pada versi Automatic1111 1.6, termasuk mengunduh Model yang diperlukan dari [Hugging Face](https://huggingface.co/lllyasviel/ControlNet-v1-1/tree/main), dan beberapa dasar antarmuka pengguna terkait untuk mengaktifkan unit kontrol dan memanipulasi gambar referensi. Video ini berfungsi sebagai titik awal yang sangat baik bagi desainer, dan peneliti AI yang mencari wawasan praktis tentang bagaimana ControlNet berfungsi dalam Model teks-ke-gambar tertentu.

## Fitur Utama ControlNet

* **Input Fleksibel**

* Menerima berbagai format Input: peta tepi, peta kedalaman, peta segmentasi, pose manusia, dan lainnya.

* Mendukung Input parsial, yang berarti pengguna dapat memberikan bimbingan minimal dan tetap melihat hasil yang signifikan.

* **Pemeliharaan Kebebasan Artistik**

* Meskipun ControlNet mengikuti Input yang diberikan, ini meninggalkan ruang untuk kreativitas yang melekat pada AI, menggabungkan maksud pengguna dengan kemampuan interpretatif Model.

* **Konsistensi yang Ditingkatkan**

* Mengatasi inkonsistensi yang sering terlihat dalam model teks-ke-gambar dengan menyesuaikan lebih erat dengan data yang diberikan pengguna, menjadikannya sangat berharga untuk desain Presisi.

* **Kompatibilitas**

* Berfungsi dengan Model difusi populer seperti Stable Diffusion dan dapat dengan mudah diintegrasikan ke dalam alur kerja yang ada.

## Demonstrasi Praktis Kemampuan ControlNet

### Kontrol Deteksi Tepi

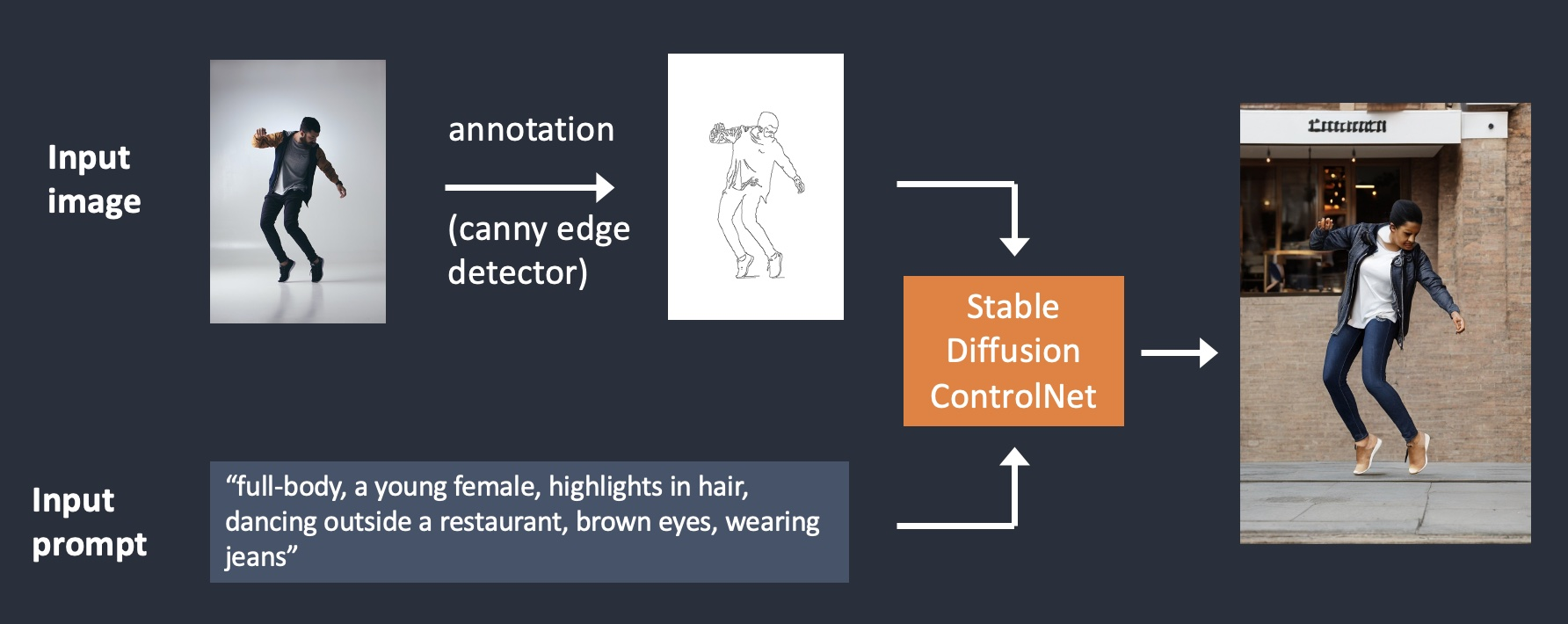

Deteksi tepi mewakili metode mendasar dalam membimbing pembuatan gambar dengan Presisi struktural. Melalui pendekatan ini, ControlNet menggunakan peta tepi yang terperinci sebagai Input kondisi, memungkinkan pengguna untuk mendefinisikan garis besar struktural yang tepat dari gambar sebelum proses pembuatan dimulai.

Gambar ini menggambarkan kekuatan ControlNet dengan pengkondisian tepi Canny di Stable Diffusion. Proses dimulai dengan gambar Input, yang bisa berupa foto atau referensi visual lainnya. Gambar ini akan berfungsi sebagai dasar untuk menciptakan Output yang Presisi secara struktural. Langkah berikutnya melibatkan deteksi tepi, dicapai melalui teknik seperti Detektor Tepi Canny. Metode ini mengekstraksi garis besar struktural utama dari gambar Input, berfokus pada mendefinisikan kontur dan pose subjek. Peta tepi yang dihasilkan adalah versi berbasis garis sederhana dari gambar asli, yang memberikan bimbingan penting untuk proses generasi.

Bersamaan dengan peta tepi, pengguna memberikan masukan teks yang menentukan detail tambahan, seperti penampilan subjek, lingkungan, dan gaya keseluruhan. Input tekstual selalu dapat menambahkan beberapa lapisan kontekstual dan gaya pada bimbingan terstruktur yang diberikan oleh peta tepi. Input-input ini kemudian diproses oleh Stable Diffusion yang terintegrasi dengan ControlNet. ControlNet memastikan bahwa gambar yang dihasilkan tetap setia kepada struktur peta tepi sambil memasukkan detail kreatif dari masukan. Hasilnya adalah Output yang sangat realistis yang mempertahankan pose dan proporsi asli namun mengubah konteks dan gaya untuk mencocokkan deskripsi pengguna.

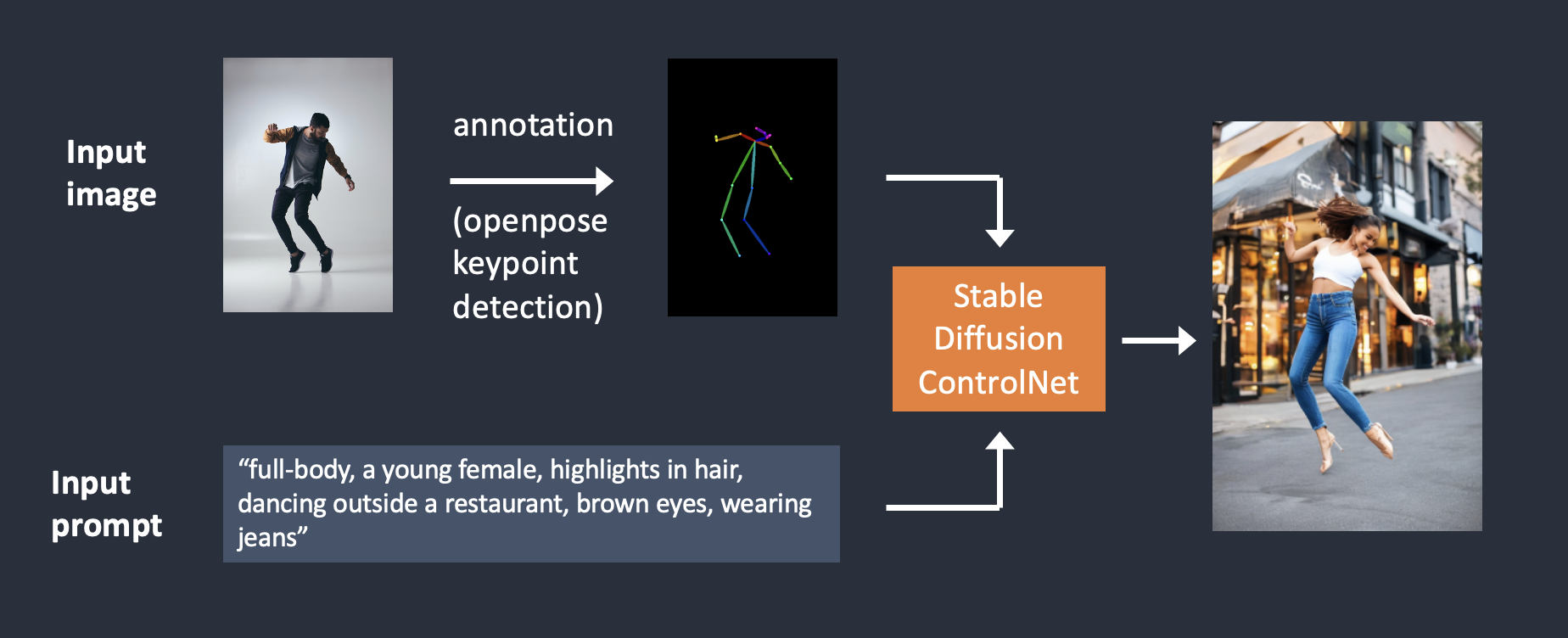

### Deteksi dan Pembuatan Pose Manusia

Deteksi pose manusia menawarkan bentuk kontrol gambar yang lebih rumit. ControlNet dapat menginterpretasikan dan mereplikasi pose manusia yang kompleks dengan ketelitian yang mengagumkan, menjadikannya sangat berharga untuk bidang mulai dari animasi hingga desain mode.

Gambar ini menunjukkan alur kerja ControlNet menggunakan OpenPose, sebuah metode terobosan untuk memasukkan Presisi struktural dengan kebebasan kreatif dalam pembuatan gambar AI. Ini dimulai dengan gambar Input, yang berfungsi sebagai referensi visual. Langkah berikutnya memanfaatkan deteksi keypoint OpenPose, yang menganalisis gambar Input untuk mengekstraksi titik-titik kunci yang mewakili posisi tubuh penting. Titik-titik kunci ini berhubungan dengan bagian-bagian seperti kepala, lengan, tubuh, dan kaki, membentuk garis kerangka subjek. Struktur kerangka ini, yang dikenal sebagai peta kontrol, menyandikan pose dan gerakan subjek sambil menghapus detail visual yang tidak diperlukan. Ini bertindak sebagai panduan struktural, memastikan Output yang dihasilkan mempertahankan pose asli.

Secara paralel, masukan teks menambahkan detail kontekstual dan gaya ke proses generasi. Baik peta kontrol maupun masukan teks dimasukkan ke dalam Stable Diffusion yang terintegrasi dengan ControlNet. Integrasi dari dua Input ini memungkinkan AI untuk mempertahankan keseimbangan antara ketelitian struktural dan kebebasan artistik. Peta kontrol memastikan gambar yang dihasilkan sesuai dengan titik-titik kunci dan proporsi tubuh dari Input, sementara masukan teks menentukan detail yang lebih halus, seperti fitur karakter, pakaian, dan latar belakang.

Alur kerja di atas semuanya menyoroti fleksibilitas ControlNet dengan Stable Diffusion, menjadikannya alat yang kuat untuk aplikasi seperti desain karakter, animasi, dan menciptakan kembali pose spesifik dalam seni. Di atas itu, ControlNet juga dapat bekerja pada Pengkondisian Peta Kedalaman yang memungkinkan kontrol atas hubungan spasial tiga dimensi, atau Kontrol Masker Segmentasi untuk memberikan kontrol mendetail atas wilayah gambar tertentu. Dengan mengintegrasikan panduan struktural dan Input kreatif dengan mulus, ControlNet selalu memungkinkan pengguna mencapai hasil yang Presisi dan mencolok secara visual.

## Tempat Belajar Lebih Lanjut

Untuk mendalami lebih jauh tentang ControlNet dan bereksperimen dengan kemampuannya, periksa sumber daya berikut:

* **[ControlNet GitHub Repository](https://github.com/lllyasviel/ControlNet)**: Jelajahi detail teknis dan akses kode sumber terbuka.

* **[Runway ML](https://www.runwayml.com/)**: Bereksperimen dengan ControlNet pada platform kreatif yang ramah pengguna ini.

* **[Hugging Face](https://huggingface.co/docs/diffusers/en/using-diffusers/controlnet)**: Pelajari tentang ControlNet dan alat AI lainnya, serta temukan Model ControlNet terlatih.

* **[Stable Diffusion](https://stability.ai/)**: Temukan ekosistem di mana ControlNet bersinar.

## Kesimpulan

ControlNet berdiri di garis depan pergeseran transformasional dalam AI generatif, menawarkan kontrol dan kreativitas yang belum pernah ada sebelumnya dalam pembuatan gambar. Dengan menyediakan mekanisme pengkondisian yang canggih, teknologi ini memberdayakan para pencipta di berbagai domain untuk mewujudkan konsep visual mereka yang paling rumit dengan Precision yang mengagumkan.

Ketika kreativitas yang didorong oleh AI menjadi arus utama, alat seperti ControlNet akan memainkan peran penting dalam mendemokratisasikan desain. Kombinasi Input pengguna dengan kemampuan generatif AI memastikan pendekatan yang seimbang, di mana baik Precision dan kreativitas berkembang. Dengan pengembangan lebih lanjut, ControlNet dapat diintegrasikan dengan modality lain, seperti pembuatan Video atau pemodelan 3D, memperluas pengaruhnya lebih jauh.

Saksikan, lalu jelajahi kemungkinan ControlNet dan buka tingkat kreativitas baru!!!