目录

简而言之: Qwen3-VL-32B — 最新的Qwen3-VL 家族成员 — 现在可以在SiliconFlow上使用。仅需32B 稠密参数,就能够实现旗舰级别的多模态推理和理解,超越 GPT-5 mini 和 Claude 4 Sonnet,同时提供更快的响应速度、更低的成本,并在效率与性能之间取得卓越平衡。通过 SiliconFlow'sOpenAI**/Anthropic兼容API**开始构建,解锁具有旗舰智能的稠密级性能。

在已在SiliconFlow上推出的 Qwen3-VL-235B 和 Qwen3-VL-8B 模型成功的基础上,Qwen3-VL-32B进一步丰富了Qwen3-VL 家族,在视觉-语言理解场景中实现了从轻量级到旗舰级型号的全覆盖。尽管只使用32B参数,其性能与235B大模型相媲美,甚至在OSWorld等基准测试中超越它们,展示了卓越的效率和推理能力。

通过 SiliconFlow 的 Qwen3-VL-32B API,您可以期待:

具成本效益的定价:

Qwen3-VL-32B-Instruct:$0.2/M tokens(Input)和 $0.6/M tokens(Output)

Qwen3-VL-32B-Thinking:$0.2/M tokens(Input)和 $1.5/M tokens(Output)

两种模型变体:

Instruct: 提供更快的响应和更稳定的执行,非常适合对话和工具调用任务。

Thinking: 增强长链推理和复杂视觉理解,能够通过挑战性多模态问题进行“观察和思考”。

262K 上下文窗口:支持无缝处理长文档和多轮对话。

无论您是在探索视觉推理、文档分析还是多模态代理开发,SiliconFlow 的 Qwen3-VL-32B API 使引入旗舰级别多模态智能到现实应用变得轻而易举。

关键特性与基准性能

Qwen3-VL 系列在多个任务中提供多模态智能 —— 从视觉理解、内容生成到推理和创造性创作,让看见和理解世界变得更轻松、更快捷、更聪明。

在这一基础上,Qwen3-VL-32B 系列在多模态和纯文本基准测试中达到了新的高度,结合稠密级效率和旗舰级性能:

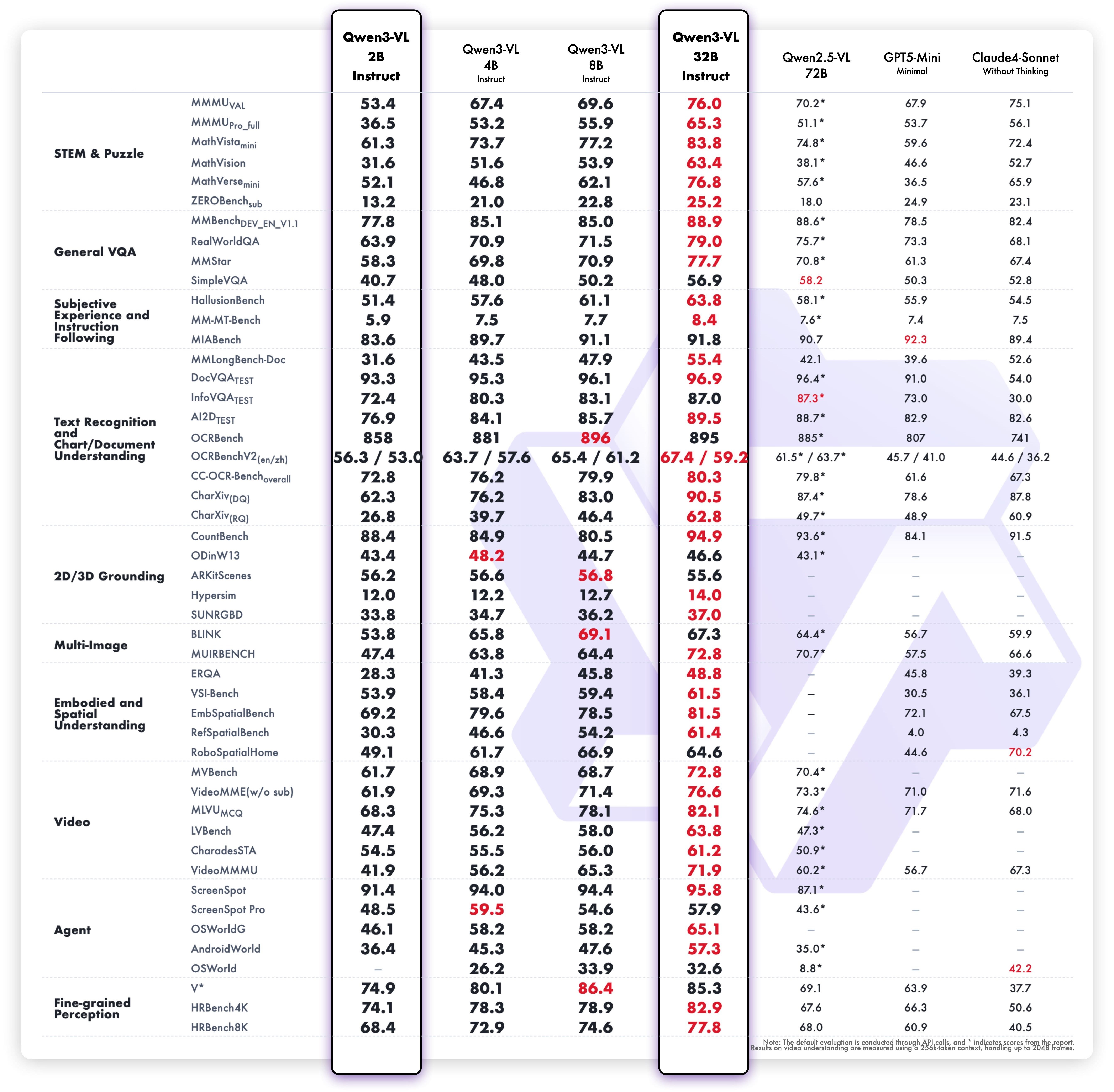

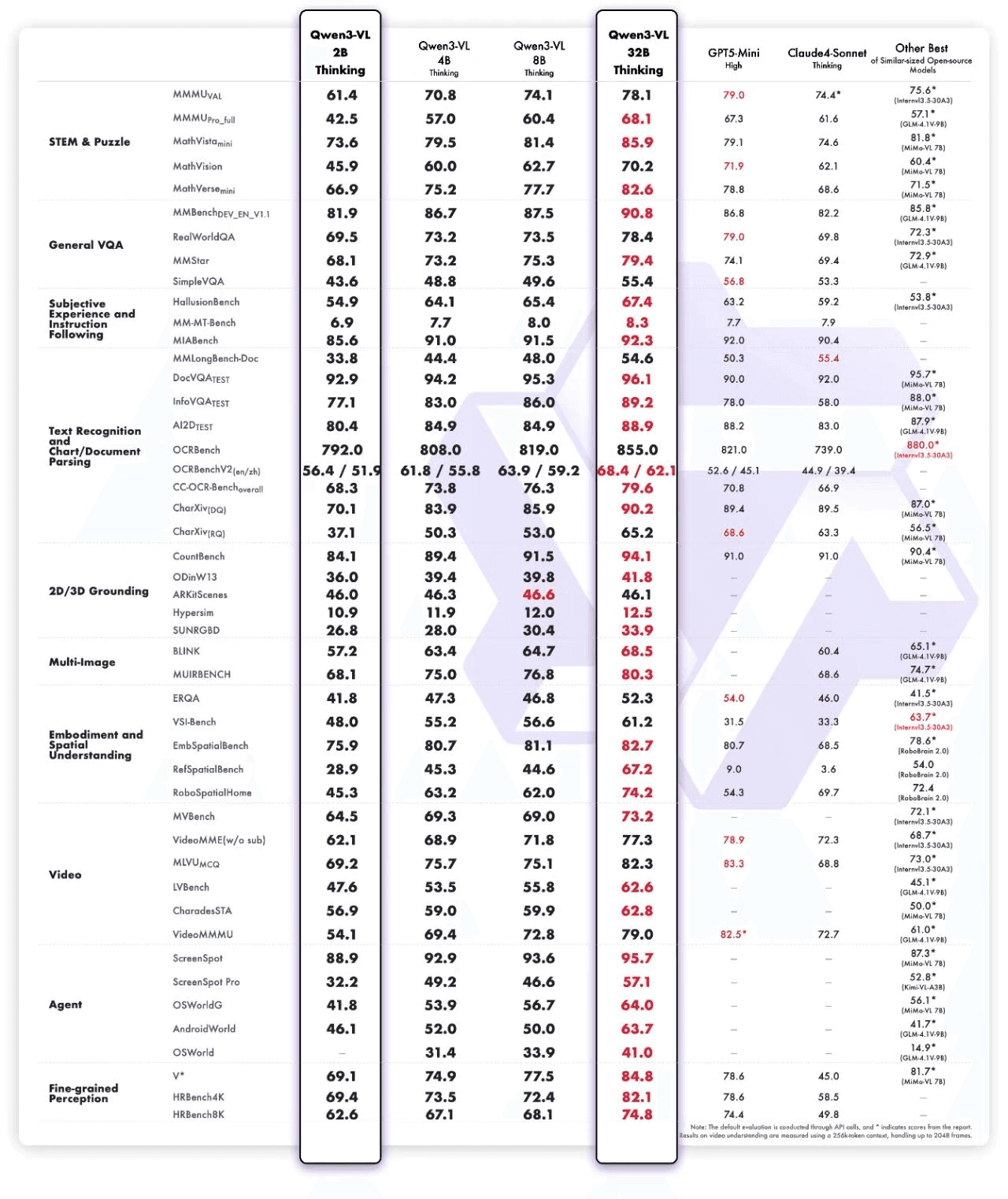

多模态性能: Qwen3-VL-32B 在STEM 推理、视觉问答 (VQA)、光学字符识别 (OCR)、视频理解和代理任务中表现出色,在关键类别中始终超越 GPT-5 mini 和 Claude 4 Sonnet。

OSWorld 排名第一:展示了其在复杂视觉代理任务中“观察、推理和行动”的能力。

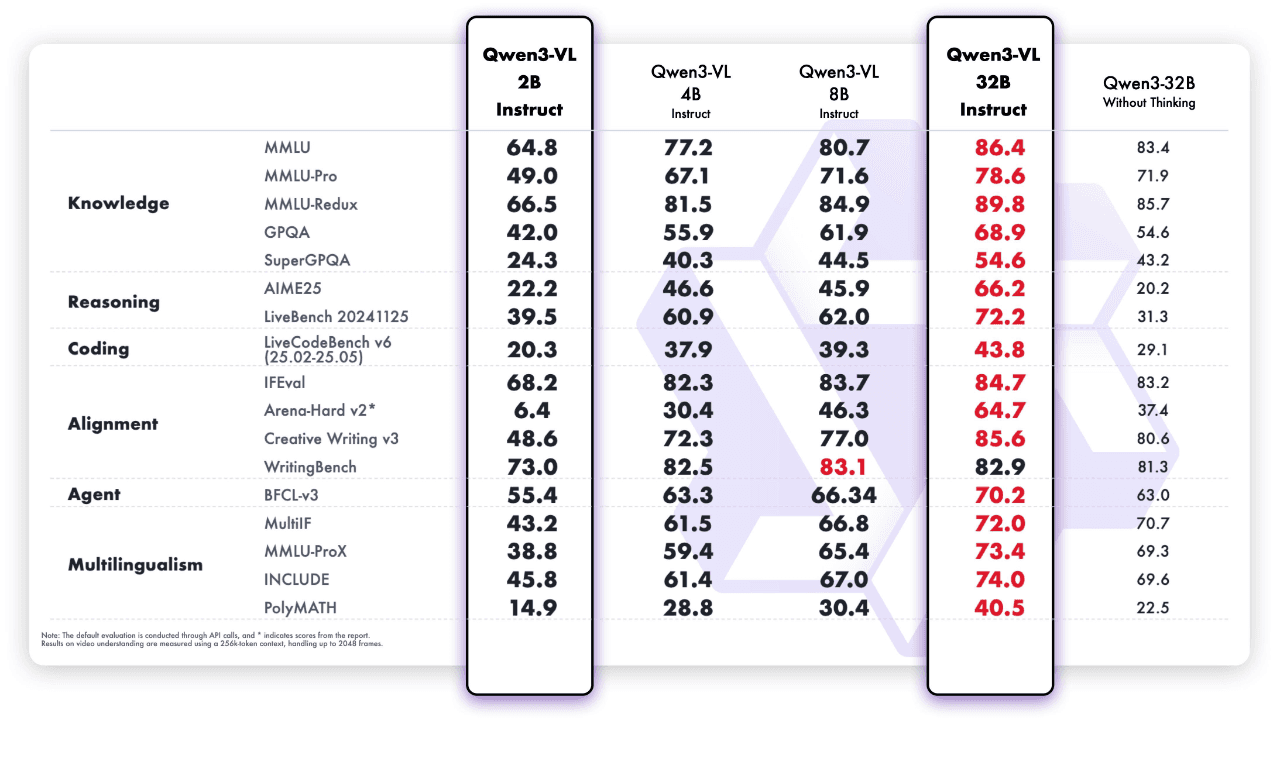

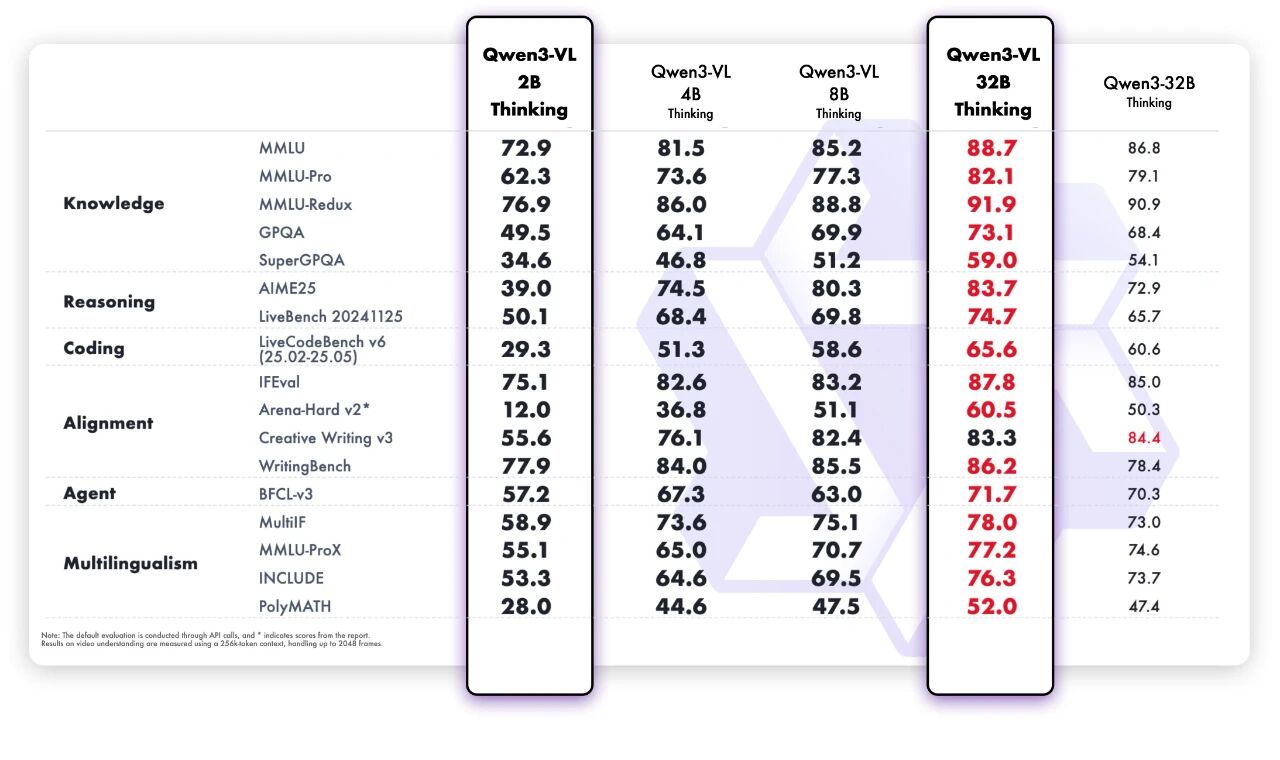

文本和推理性能:Qwen3-VL-32B 同样在纯文本推理中表现出色,展现了在语言理解和逻辑推理方面的稳健表现。

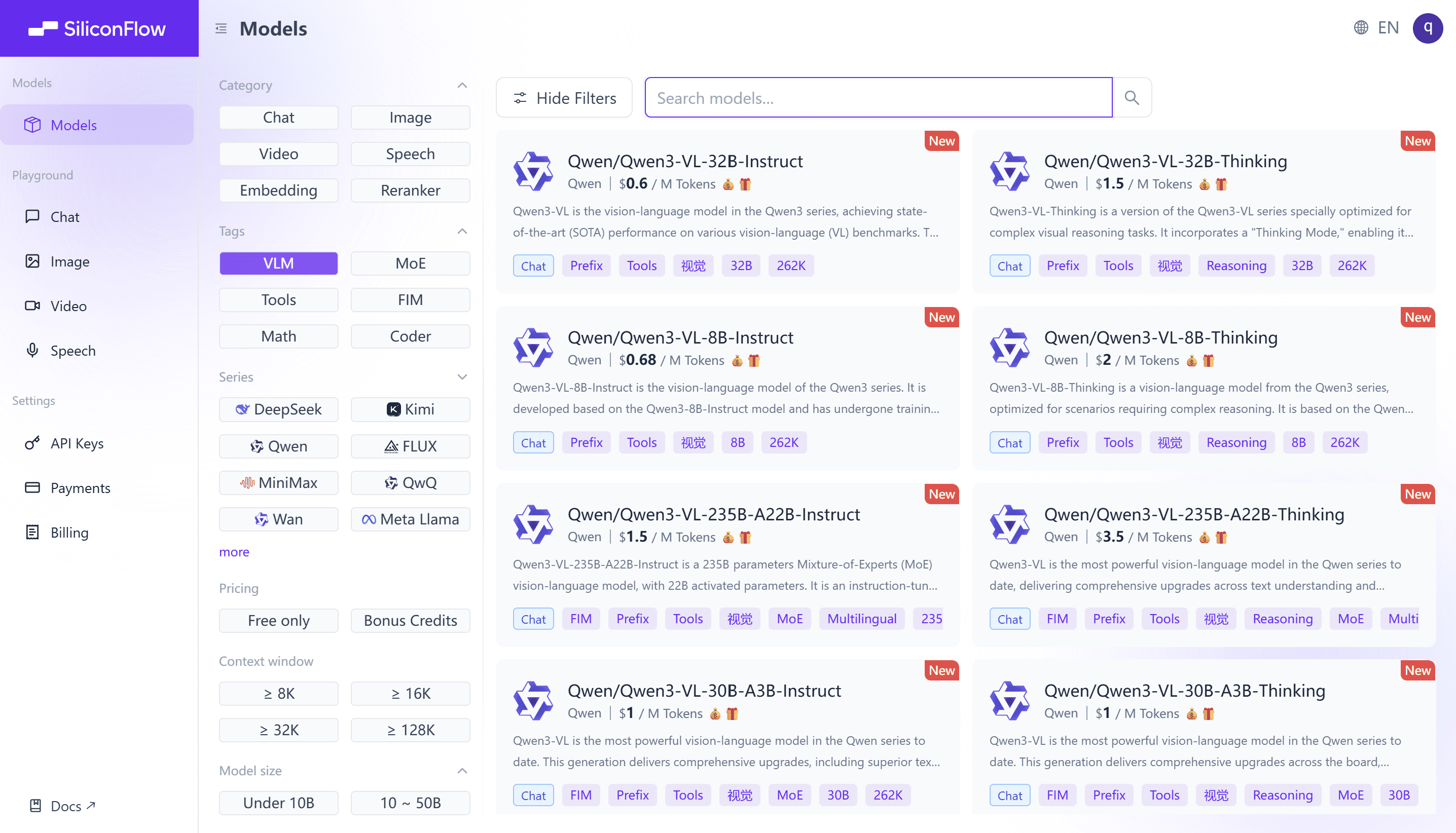

截至今日,SiliconFlow 提供了一整套Qwen3-VL 模型,其特点包括:

稠密模型:Qwen3-VL-8B 和 Qwen3-VL-32B

MoE 模型:Qwen3-VL-30B-A3B 和 Qwen3-VL-235B-A22B

每种模型都提供 Instruct 和 Thinking 变体,允许开发人员灵活访问相应的API 服务,并选择性能、效率和推理深度之间的适当平衡。

真实应用场景

为开发者和研究人员打造,Qwen3-VL-32B 在多模态 AI 应用中解锁了新的可能性:

视频理解与分析:识别动作,总结场景,并跟踪长视频中的时间动态,适用于自动化或媒体智能。

视觉推理与 STEM 任务:解释图表、科学图表和复杂数学问题的上下文推理,适用于教育、研究和技术文档。

多模态代理:将感知和推理联系起来,构建能够理解图像、分析数据和采取上下文行动的智能助手。

文档和 OCR 理解:从扫描的文档、收据或手写笔记中提取和总结关键信息,高精度提取。

立即开始

探索:在SiliconFlow 模型广场中试用 Qwen3-VL-32B。

集成:使用我们的 OpenAI 兼容 API。请在 SiliconFlow API 文档中探索完整的 API 规格。

通过SiliconFlow 的 API解锁长上下文多模态推理和智能代理功能!